DEEPFAKE ANA AKIMA DÖNÜŞÜRKEN, DEEPWARE SCANNER İLE BAŞLAYAN ÇEVRİMİÇİ TARAMA KRİTİK ÖNEM KAZANIYOR

DEEPFAKE ANA AKIMA DÖNÜŞÜRKEN, DEEPWARE SCANNER İLE BAŞLAYAN ÇEVRİMİÇİ TARAMA KRİTİK ÖNEM KAZANIYOR

Zemana CEO Orhan Akyürek

Zemana CEO Orhan Akyürek

Deepfake olarak adlandırılan sentetik medya içerikleri, insanlığın gerçeklik algısını hedef alıyor. Böylece nesnel gerçekliğin sanal gerçekliğe evrilmesine hizmet ediyor. Diğer yandan deepfake niteliğindeki medya içeriklerinin sayısı ve dolaşımı, ana akım sayılabilecek bir düzeye ulaşacak biçimde artıyor.

Yapay Zeka’nın (AI) bu ele avuca sığmayan yaramaz çocuğu, kaotik dezenformasyon savaşlarını tırmandıracak küresel bir tehdit mi, insanlığın yaşam kalitesini yükselten bir teknolojik gelişme mi, yoksa dijital dönüşümün yeni eğlence ve pazarlama alanı mı? Deepfake teknolojisinin hayatı nasıl değiştireceği, doğaldır ki tartışılabilir. Ancak deepfake medyayı gerçeğinden ayırt edebilme olanağı sağlayan tarama ve algılama çözümleri geliştirmek, oluşabilecek çevrimiçi tehlikelerden korunabilmenin, tartışmasız ön koşulu olacak.

Deepfake, çevrimiçi dünyada sahte videolar başta olmak üzere, manipüle edilmiş sahte sentetik medyanın genel adı olarak kullanılıyor. Sağlıklı bir değerlendirme yapabilmek için, önce doğru bir tanımlama yapmak gerekiyor. Bir medya içeriğinin deepfake olarak nitelendirilebilmesi için, derin öğrenme olarak tanımlanan makine öğrenme sistemi ve yapay sinir ağları kullanılarak üretilmiş ya da değiştirilmiş olması gerekiyor. AI öncesi başvurulan klasik montaj hileleri, bu tanımın dışında kalıyor.

Derin öğrenme ve yapay sinir ağlarına dayalı AI teknolojisi

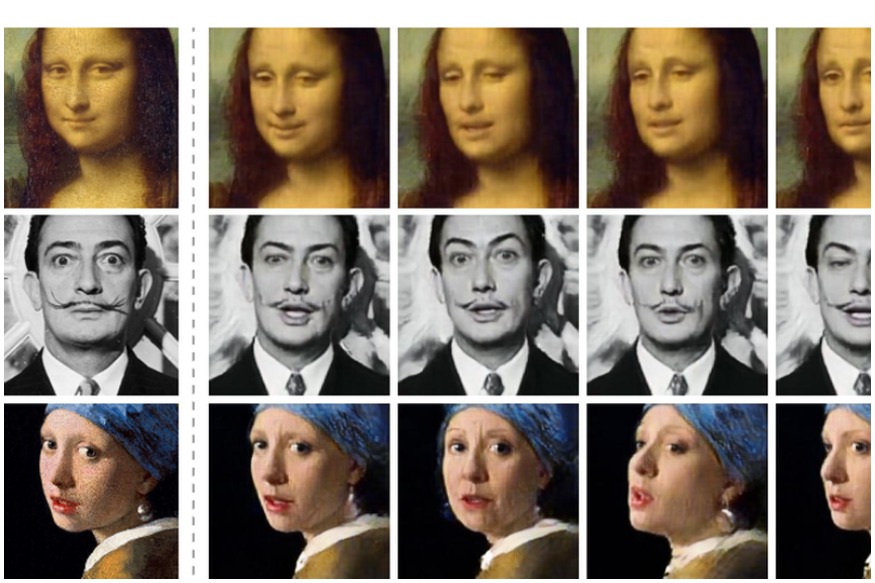

Makine öğrenimi, bilgisayarların görüntüyü, sesi ve metni, hızlı ve kolay bir şekilde otomatik olarak oluşturmasını mümkün kılıyor. Yapay sinir ağları, hedef medyayı, kaynak içerik kadar hiper gerçekçi düzeye yaklaştıracak biçimde, görüntü, hareket, ses ve kelime dizinlerini öğrenmek üzere eğitiliyor. Eğitimli ağ, daha sonra medya içeriği üzerinde, sentez ve takas işlemlerini gerçekleştiriyor. Kodlayıcı ve kod çözücü AI algoritmaları sayesinde, medya içeriklerini, manipülasyon senaryosuna uygun biçimde yapılandırıyor. Yüz değiş tokuşları ve ses klonlama, aslında gerçek olanı taklit etmeyi amaçlıyor. Ancak derin öğrenme, tamamen hayali insanları veya nesneleri avatarlar şeklinde tasarlamak veya kimseye ait olmayan sentetik sesler üretmek için de kullanılabiliyor. AI ayrıca, insan tarafından yazılmış metnleri taklit edebilen sentetik metinler de üretebiliyor.

Sentetik medya oluşturmak için kullanılan teknolojiler, son birkaç yılda hızla gelişti ve çoğaldı. Makine öğrenimi bilimindeki ve büyük ölçekli veri toplama, işleme, depolama ve iletimdeki atılımlar, sentetik medyanın çok daha gerçekçi görünmesini sağladı. Kullanıcı dostu açık kaynaklı yazılımlar ve ucuz bulut bilişim olanakları, artık teknik açıdan bilgili herhangi bir kişinin, bazen ücretsiz bir web ara yüzü veya mobil uygulama aracılığıyla deepfake medya içeriği oluşturmasına olanak tanıyor. İlk dönemde sıklıkla deepfake'in, Üretken Rakip Ağlar (GAN) adı verilen yapay sinir ağı ile üretildiği varsayılsa da, son dönemde çevrimiçi dolaşımdaki birçok deepfake içerik, GAN'lar dışındaki sinir ağlarına dayanıyor.

Deepfake’in ilk ortaya çıkışı ve yayılma alanı yetişkin medya içerikleri

Deepfake’in ilk ortaya çıkışı, 2017 sonlarında kimliği belirsiz bir kullanıcının, ünlülerin yüzlerini rızaları dışında AI algoritması ile pornografik videolara ekleyip, bu videoları Reddit.com’da yayınlamasıyla olmuştu. Deepfakes adlı kullanıcı, böylece hem deepfake’in, hem de daha sonra intikam pornosu olarak adlandırılacak, sahte yetişkin içeriklerinin de fitilini ateşlemiş oldu.

Deepfakes'in yarattığı en büyük sorunlardan birini, insanların yüzlerini pornografik görüntülerle birleştirerek üretilen rıza dışı pornografi oluşturuyor. Çevrimiçi deepfake'lerin halen çoğunluğu pornografik nitelik taşıyor. Bir AI firması tarafından yapılan araştırmaya göre, Eylül 2019'da çekilen yaklaşık 15.000 deepfake videodan oluşan örneklemenin yaklaşık% 95'i pornografikti. Geçen Temmuz’da yayınlanan bir araştırmaya göre, mesajlaşma uygulaması Telegram’dan yaklaşık 104.000 bin kadının verileri elde edilerek, deepfake çıplak görüntüleri, çevrimiçi dolaşıma çıkmıştı ve bunların %70’i sıradan kişilerdi. Görüntüler, kurbanların hesaplarından elde edilmişti. Gençlerin en çok rağbet ettiği son dönemin en popüler sosyal medya platformlarından Tik Tok da, rıza dışı deepfake porno içerikleriyle bir hayli sorun yaşadı. İnsanların görüntülerini çıplak gösteren DeepNude gibi mobil deepfake uygulamaları yayından kaldırılmış olsa da, internetin karanlık köşelerindeki yansımaları tümüyle son bulmadı.

Deepfake’in “eğlenceli görünen” yüzü

Mizah ve eğlence, deepfake’in en masum görünen yüzü olarak ortaya çıksa da, özellikle mobil uygulamalar biçiminde sunulan deepfake teknolojisinin aslında hangi niyetle kullanılacağı sonucu belirliyor. 2019’da Teksas ile başlayarak, bugüne kadar sadece Virginia, California gibi birkaç eyaletinde sınırlı yasal düzenlemeler gerçekleştirilen ABD’de, deepfake için federal ölçekteki “Hesap Verebilirlik Yasası” çabaları, sürekli “fikir özgürlüğü” engeline takılıyor. Tom Cruise’un Tik Tok’ta yer alan son deepfake videosu örneğinde olduğu gibi, Holywood yıldızları ve siyasetin önde gelen profillerine yönelik, hiciv niteliği taşıyan deepfake medya içerikleri, kitlelere eğlenceli görünüyor. Oysa, ABD Temsilciler Meclisi Başkanı Pelosi’yi sarhoş göstermek amacıyla yavaşlatılmış biçimde yayınlanan videosunda, deepfake niteliği tartışmalı olsa da, siyasi saldırı niteliği ağır basıyordu.

Ünlü ve önemli kişilerin deepfake videoları, mizah ve hiciv nitelikli ifade özgürlüğü şemsiyesi altında dolaşıma sokulurken, bu durum yakında sıradan insanların başına da gelmeye başlayacak gibi görünüyor. Aralarında bir Türk girişimci tarafından pazara sunulan Impressions’un da yer aldığı, Deepfake Studio, Reface gibi FaceSwap teknolojisi içeren mobil uygulamalar sayesinde, sadece bir selfie ile artık kolayca eğlenceli deepfake video içeriği üretilebiliyor. Birçokları için gülünç olan bu içeriklerin, kimseye zarar verip vermeyeceği ise, gelecekteki kullanım biçimleriyle ortaya çıkacak.

Deepfake, finansal sistemi tehdit ediyor

Deepfake, finansal suçların gelişmesi ve yaygınlaşması açısından, sadece bireyler ve şirketler için değil, finans ve ekonomi sistemlerine yönelik olarak da büyük bir tehdit ve tehlike içeriyor. Fintech firmaları ve finans dünyasının, yeni nesil çevrimiçi finansal suçlarla mücadele edebilmek için, iki temel deepfake türüne karşı önlem alması, teknolojik ve mental siber güvenlik altyapılarını geliştirmesi gerekiyor. Bunlar; sahte sentetik ses ve video.

University College London 2020 raporuna göre, sahte ses ve video içeriği; yol açacağı zarar, siber saldırganlara sağlayabileceği kar potansiyeli, kullanım ve üretim kolaylığı gibi kriterler açısından, AI’nin suç amaçlı 20 kullanım yöntemi arasında, artık ilk sırada yer alıyor. Ayrıca Kovid-19 pandemisi, insanları kimliğe bürünme dolandırıcılıklarına karşı daha korumasız hale getiriyor. Yüz yüze temas olanakları kısıtlandığı için, çalışanlar hileli ödeme onayına yönelik her an bir deepfake saldırı tehdidiyle karşı karşıya bulunuyor. Siber saldırıların yol açacağı küresel zararın, 2023 sonunda 6 trilyon dolara ulaşacağı öngörülüyor.

Dolandırıcılık, sahtecilik, borsa ve piyasa manipülasyonu gibi aldatma suçları, artık deepfake’in sağladığı inandırıcılığı da kullanarak, her an ekonominin kendi koşullarından yararlanan tehditler olarak karşımıza çıkabilir. Kişileri, anlık bir görüntülü görüşme ile kandırıp dolandırmayı sağlayan deepfake, dış ticaret, faiz ya da kur politikaları ile ilgili dezenformasyona yol açacak manipülatif medya içerikleriyle, şirketleri, tasarruf ve yatırım sahiplerini yanlış yönlendirip, bütün bir ekonomik sistemin geçici de olsa kilitlenmesine yol açabilir. Borsaya ya da bankacılık sistemine yönelik güveni tahrip edebilir. Yeni teknolojileri saldırı planlarına dahil eden siber korsanlar, deepfake teknolojisine de giderek uyum sağlamaya başlamış görünüyorlar. 2019 yılında şirket CEO’sunun sesi kullanılarak gerçekleştirilen sahte havale emri, İngiltere’deki bir enerji şirketine tam 243 bin dolara mal olmuş ve bu ilk büyük finansal deepfake saldırısı olarak adli kayıtlara geçmişti. Bu nedenle, deepfake gibi yeni ve etkili aldatma araçlarının, finansal suçları nasıl daha tehlikeli hale getireceğini görmezden gelebilmek mümkün değil.

Dezenformasyonun yıkıcı etkisi

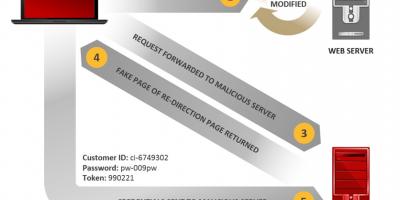

Deepfake tehlikesinin temeli, dezenformasyon tehdidine dayanıyor. Çünkü, orijinal bir medya içeriğinin AI yardımıyla değiştirilmesi ya da gerçekte olmayan görüntü, ses ve metin içerikleri üretilmesi, öncelikle kurbanları inandırmayı ve yanıltmayı amaçlıyor. Bu tür siber saldırıların son derece iyi kurgulanmış stratejik sosyal mühendislik senaryolarına dayandırıldığı da dikkat çekiyor.

Ünlü bir siyasetçi, fikir önderi, iş insanı, sanatçı ya da sporcunun, sahte görüntüsü ve sesiyle oluşturulacak deepfake niteliğindeki sentetik medya içerikleri, onun hakkında kolaylıkla yanlış bir algıya yol açabilir. Kişiye yönelik saygınlık ve güveni zedelediği için itibar cellatlığı olarak adlandırılan bu saldırıdan, sadece ilgili kişiler değil, dezenformasyondan etkilenerek, yanlış karar, inanış ve davranışlara sürüklenen kitleler de büyük zarar görür.

Özellikle pandeminin yol açtığı kapanma sürecinde, toplum sağlığını tehlikeye sokacak sonuçlara yol açabilecek deepfake saldırıları, hala büyük bir tehdit olarak varlığını koruyor. Mynmar’daki darbe sürecinde olduğu gibi, siyasetçiler ile ilgili gerçekleri manipüle edecek şekilde demokrasiyi hedef alan örnekler de giderek artabilir. ABD’deki son başkanlık yarışı ise, yaşanan büyük kaygı ve gerilime karşın, küçük birkaç girişimin dışında, beklenen büyük deepfake saldırıları yaşanmadan atlatıldı. Deepfake medya içerikleri, adli bilişim konusu olacak düzeyde, suçu örtecek sahte delillere dönüşebileceği gibi, hiç beklenmedik bir zamanda, bir şirket ya da kurum yöneticisi ya da çalışanları üzerinden, kamuoyu güvenini sarsacak biçimde, her türlü iftira ve suçlamaya kaynak oluşturma potansiyelini de barındırıyor.

Derin sesler, deepfake’in alarm sireni

Sesi sentezleme ya da klonlama yoluyla üretilen derin sesler, deepfake kıyametinin siren sesleri olarak kabul edilebilir. Çünkü böylece puzzle'ın göreceli eksik kalan en inandırıcı parçası tamamlanmış olacak. Ses takası videolarda olduğu gibi, hedefin sesini taklit etmek için bir makine öğrenme algoritmasına dayanıyor. Deepfake ses profili oluştururken, “eğitim verileri” algoritmasını besleyecek ses modeli için, hedefin ses verileri, çoğunlukla konuşmalar, sunumlar, kurumsal videolar ve röportajlar gibi halka açık kaynaklardan kolayca toplanabiliyor. Yeterince sağlam bir deepfake ses profili oluşturulduktan sonra, sahte sesin okunmasına yönelik senaryolar için, metinler hazırlamak yeterli oluyor.

Bugüne kadar dijital görüntü sentezlemede, pek çok başarılı model geliştirilerek, hiper gerçekçi düzeye yakın kalitede sentetik video içerikleri üretilmesine karşın, ses sentezlemede henüz aynı düzeye ulaşılamamıştı. Sentetik ses sentezi için yaygın olarak kullanılan, metinden konuşma (text2speech) tekniği, mekanik tekdüze sonuç verdiği için, inandırıcılık düzeyi, görüntü sentezinin gerisinde kalıyordu. AI şirketi Dessa'nın mühendisleri tarafından, 2019 yılında, ünlü podcast sunucusu Joe Rogan'ın sesinin, çok inandırıcı biçimde taklit edilebilmesi, çevrimiçi dünyada büyük ses getirmişti. Ancak, “Ses değişimi” teknolojisi, bu alanda efsane bir gelişme olarak bekleniyordu. Türk siber güvenlik şirketi Zemana'nın AI girişimi olan Deepware AI, geliştirdiği ilk VoiceSwap teknolojisi DeepVoiceLab alfa sürümüyle, metin yardımı olmadan kaynak videodan ses değiştirmeyi başardı. Deepware AI, böylece deepfakes tehdidinin en tehlikeli türü olan ses sahtekarlıklarının, artık kapıya dayandığını ortaya koydu.

Deepfake tespit ve algılama çözümleri

Deepfake medya içerikleri gittikçe daha karmaşık hale geldikçe, onları gerçek medyadan ayırmak daha da zorlaşacak. Başlangıçtan bugüne kadar, zayıf dudak senkronizasyonu, doğal olmayan hareketler, yüz kenarındaki titremeler, saçlar, dişler ya da benzeri ince detaylardan oluşan ipuçları, dikkatli bir gözlemle deepfake’i ele verebiliyordu. Bir derin sahteciliğin diğer olası belirtileri arasında, aynı videonun düşük kaliteli kısımları ve düzensiz göz kırpma da yer alıyordu. Ancak, deepfake geliştiricilerin AI yardımıyla ürettikleri yeni teknikler ve algoritmalar, bu ipuçlarını giderek ortadan kaldırıyor. Bu durum, yine AI algoritmalarına dayalı deepfake tarama va algılama teknolojileri geliştirmenin önemini, giderek daha kritik hale getiriyor.

Teknoloji, siber güvenlik ve AI şirketleri bir yandan deepfake tespit ve algılama modelleri için ar-ge çalışmaları gerçekleştirirlerken, diğer yandan çevrimiçi dünyanın dev şirketleri bu doğrultudaki çalışmaları teşvik ediyorlar. Facebook ve Microsoft liderliğinde büyük beklentilerle 2019 Aralık ayında başlayan ve 6 aydan uzun bir organizasyonla gerçekleştirilen Deepfake Detection Challenge (DFDC), bu alandaki ilk ve en büyük global deepfake tespit modeli geliştirme yarışması oldu. Her kıtadan 2114 ekibin 35.000’den fazla deepfake tespit algoritmasıyla katıldığı mücadelenin final etabında, yarışmayı birinci bitiren model, ancak %65,18’lik bir deepfake tespit performansına ulaşabildi. Bu sonuç, AI temelli siber güvenlik algoritmalarının, her tür deepfake’i yakalamak konusunda, henüz yolun en çok üçte ikisini kat edebilmiş durumda olduklarını ortaya koyuyordu. DFDC’ye 1. sıradan giriş yapıp bu alandaki iddiasını kanıtladı.

İsviçre’den Quantum Integrity, Estonya’dan Sentitel, İsrail’den Cyabra, Hollanda’dan Sensity, Türkiye’den Deepware gibi pek çok AI girişimi, deepfake tespit ve algılama teknolojilerini geliştirmek için mühendislik yatırımlarını sürdürüyorlar. Bunlarla birlikte Google ve Jigsaw ortak girişimi Assambler, Google Dijital Haber İnovasyon Fonu (DNI), Deutsche Welle (DW), Fraunhofer Dijital Medya Teknolojileri Enstitüsü (IDTM) ve ATC İnovasyon Laboratuarı ortak girişimi olan Digger da aynı alanda çalışmalar yürütüyor. Kurucuları arasında, Twitter, Blogger, Medium gibi küresel şirketler, iş insanı Christopher Isaac (Biz) Stone ve dünyaca ünlü dijital görüntü analizi uzmanı Prof. Hany Farid ‘in de yer aldığı AI Vakfı, topladığı 27 milyon dolarlık fonla, Twitter, Google ve Microsoft ile işbirliği gerçekleştirerek, sahte sentetik medya tespiti için Reality Defender teknolojisini geliştiriyor. Ayrıca Peerwise ve Pindrop gibi girişimler de özellikle çağrı merkezleri, finans kuruluşları ve gsm operatörleri için, spesifik olarak derin sesleri tespit ve algılama teknolojileri geliştirmek için çalışıyorlar.

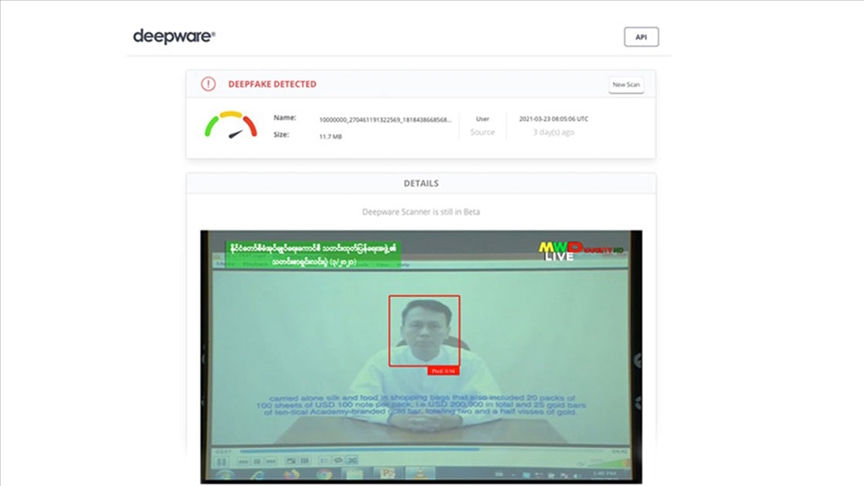

Deepware AI çevrimiçi taramanın dünyadaki öncüsü

Deepfake tespit ve algılama teknolojisi geliştiricileri, modellerini kurumsal müşterilere özel hizmet paketi (API, SDK) şeklinde sunmayı tercih ederlerken, teknolojisini çevrimiçi bireysel kullanıcılara ilk sunan Türk AI girişimi Deepware oldu. Deepware AI, geliştirdiği deepfake tarama ve algılama motoru Deepware Scanner’ı, kendi web sitesi deepware.ai üzerinden, geçen yıl dünyada ilk kez çevrimiçi kullanıcılara ücretsiz olarak sundu.

Deepware AI, iki yılı aşan ar-ge sürecinde, güçlü algılama algoritmalarına odaklanarak, çift katmanlı bir algılama motoru geliştirdi. Beta sürümü, çevrimiçi olarak ücretsiz sunulan Deepware Scanner, kullanıcıların gerçekliğinden emin olmak için videolarla ilgili deepfake sorgulaması yapabilmelerine olanak tanıyor. Deepware Scanner, Face Swap teknolojisiyle yüzlerin değiştirildiği deepfake videoları ve sesli iletişim alanlarındaki herhangi bir sahte içeriği saptamak için tasarlandı. Çevrimiçi kullanıcılar, bir videodaki yüzlerin deepfake olup olmadığını anlamak için, deepware.ai internet adresinden, dijital içeriğin linkini ekleyerek ya da dijital içerik dosyasını yükleyerek, ücretsiz taratabiliyorlar. Sosyal medya ağları başta olmak üzere, farklı platformlar bu teknolojiyi kendi sistemiyle de bütünleştirebiliyor. O durumda, kullanıcılar, sahte bir içerik izlediklerinde, okuduklarında veya duyduklarında, sistem onları otomatik olarak uyarıyor. Böylece hükümetler, sosyal ağlar, anlık mesajlaşma uygulamaları ve medya, sahte sentetik içerikleri topluma zarar vermeden bunları tespit edebiliyor. Geliştirdiği yeni nesil AI teknolojisini, geliştiriciler için açık kaynak kodlu olarak yayınlayan Deepware AI, bu teknolojiyi aynı zamanda API ve SDK formlarında da kullanıma sundu. Deepware AI, özellikle çocukları çevrimiçi sakıncalı içeriklerden korumak için, son olarak Adult Scanner teknolojisini geliştirdi.